San José, 10 sep (elmundo.cr) – En EL MUNDO CR se llevó a cabo un análisis utilizando la herramienta Deepfake Total del Instituto Fraunhofer, que permite determinar el porcentaje en que un audio puede estar manipulado mediante Inteligencia Artificial.

Esto luego de que el exministro Luis Amador señaló que “no reconozco la legitimidad de los audios en donde supuestamente se escucha mi voz”.

El exministro Luis Amador supuestamente propuso un plan para que la Asamblea Legislativa inhabilitara al presidente de la República, Rodrigo Chaves, por problemas mentales.

Esto consta en unos audios que fueron publicados por Trivisión Canal 36, donde Amador conversa con integrantes del grupo que se organizaba para llevarlo a ser candidato presidencial en las elecciones nacionales de 2026.

Por su parte, el presidente de la República, Rodrigo Chaves, señaló que “en los audios (Luis Amador) llama abiertamente a un golpe de Estado y dice estar en conversaciones con otra gente”.

¿Qué es un audio Deepfake?

La palabra deepfake se refiere a una técnica de inteligencia artificial que utiliza algoritmos avanzados para crear contenido audiovisual falsificado pero altamente realista, como videos o audios en los que se manipula la apariencia, la voz o las acciones de una persona para hacerla parecer que dice o hace algo que en realidad no hizo.

El término proviene de una combinación de deep learning (aprendizaje profundo) y fake (falso).

Detectar cuando un audio es creado por una IA puede ser una tarea difícil por el perfeccionamiento de las herramientas de generación de contenidos. Por eso varias instituciones que se preocupan por detectar las fake news han desarrollado herramientas para ayudar a los periodistas en su trabajo.

Entre estas instituciones se encuentra el Instituto Fraunhofer, la mayor organización de servicios de investigación aplicada y desarrollo de Europa.

Este instituto desarrolló una plataforma llamada Deepfake Total, que posibilita la carga de archivos de audio sospechosos y los somete a un análisis detallado.

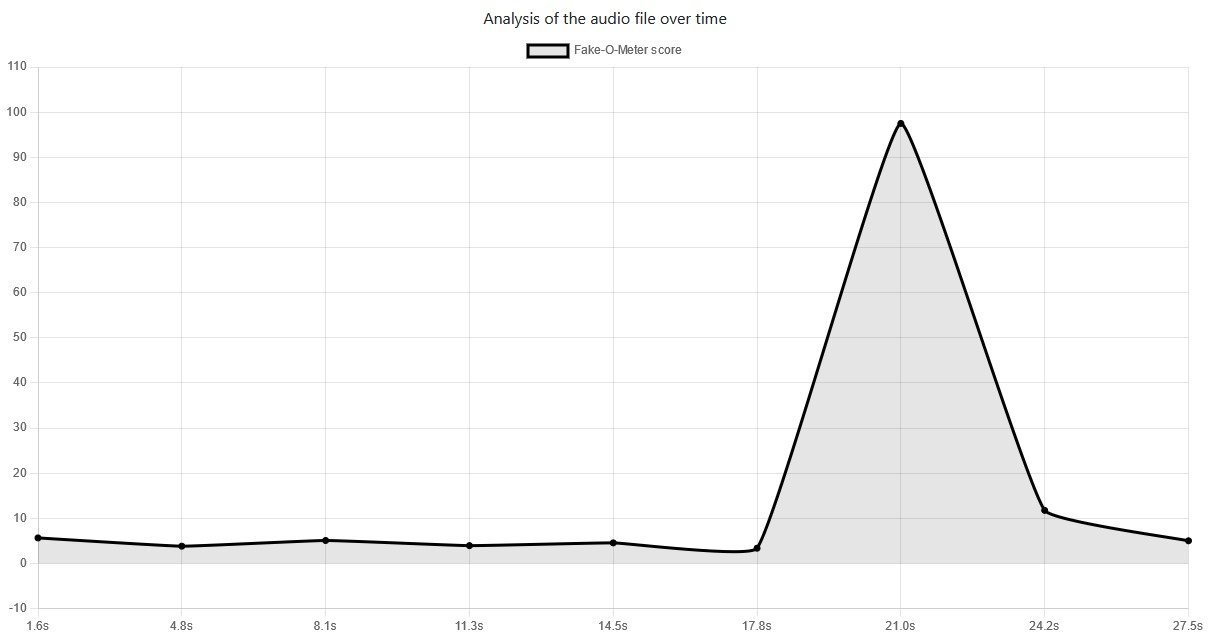

El análisis toma en consideración los primeros 90 segundos de un audio, separándolos en segmentos de 3 segundos. Posteriormente evalúa cada segmento de manera detallada, asignando un porcentaje según la posibilidad de ser creado por una IA. Cuanto mayor sea el valor, mayor es la probabilidad de que el audio en ese momento específico haya sido generado por IA.

Tomando en consideración esto, califica el audio en una escala llamada “fake-o-meter”, indicando la probabilidad de que el archivo sea artificial.

Audio de Luis Amador analizado

El siguiente es el audio del exministro Amador que fue analizado:

Para el caso del audio de Amador, se analizó un fragmento del audio y se obtuvo los siguientes resultados.

Porcentaje de probabilidad de uso de IA:

- Al referirse sobre utilizar la salud mental de Chaves para destituirlo: 3% (aprox.)

- Calificación total del audio: 15.6%

¿Cómo funciona el modelo de análisis?

El modelo Deepfake Total asignó un puntaje promedio de deepfake de 15.6%. Esto indica que el audio tiene tan solo 15.6% de sposiblidades de ser deepfake. Es decir, muy posiblemente el audio sea real.

Al analizar los segmentos detalladamente podemos ver que en casi la totalidad de los segmentos de 3 segundos, los porcentajes de posibilidad de ser un deepfake se mantuvo cercano del 3%. Principalmente en aquellas partes del audio en las que se hace referencia a que la Asamblea Legislativa declare al presidente como “mentalmente inestable” o “bipolar”.

Cabe detallar que ninguna herramienta para detectar deepfakes es completamente infalible. Sin embargo, la estimación de probabilidades de que un archivo sea generado por IA es un buen punto de referencia para ayudar a determinar la veracidad de un audio.

Por eso los resultados deben ser tomados con cautela, y solo como parte de los múltiples pasos de verificación.